Uma pesquisa da Deloitte indica que apenas 23% das organizações se sentem totalmente preparadas para gerir os riscos relacionados com a IA, deixando lacunas significativas na supervisão e na segurança.

- O que é a governação da IA?

- Quadros de governação da IA

- Diretrizes éticas e responsabilidade

- Quadros regulamentares

- Transparência e explicabilidade

- Monitorização e melhoria contínua

- MetaDefender Managed File Transfer MFT) – Solução de segurança e conformidade com IA

- FAQs sobre a governação da segurança da IA

O que é a governação da IA?

A governação da IA é o sistema de políticas, estruturas e supervisão que orienta a forma como a inteligência artificial é desenvolvida, utilizada e regulamentada. Garante que a IA funciona com transparência, responsabilidade e segurança em organizações, indústrias e governos.

A proteção dos sistemas de IA para que possam funcionar de forma segura, ética e em conformidade com os regulamentos tornou-se uma prioridade máxima. Sem uma governação adequada, os sistemas de IA podem introduzir preconceitos, violar requisitos regulamentares ou tornar-se riscos de segurança.

Por exemplo, uma ferramenta de recrutamento de IA treinada em dados históricos de contratação pode inadvertidamente dar prioridade a certos dados demográficos em detrimento de outros, reforçando padrões discriminatórios. Em sectores como os cuidados de saúde ou as finanças, a implementação de IA sem cumprir as leis regionais de proteção de dados pode resultar em violações regulamentares e multas substanciais.

Além disso, os modelos de IA integrados em serviços virados para o público sem controlos adequados de prevenção de ameaças podem ser explorados através de tentativas de exploração maliciosas, expondo as organizações a ciberataques e perturbações operacionais.

Princípios fundamentais da governação da IA

Uma estratégia de governação de IA bem definida incorpora princípios essenciais que ajudam as organizações a manter o controlo sobre a tomada de decisões orientada para a IA. De acordo com um inquérito do Ponemon Institute, 54% dos inquiridos adoptaram a IA, enquanto 47% das equipas de segurança comunicaram preocupações sobre as vulnerabilidades introduzidas pelo código gerado pela IA.

Os seguintes princípios fundamentais são fundamentais para uma governação eficaz da IA e ajudam a mitigar os riscos operacionais e de segurança:

Os protocolos de segurança protegem os modelos de IA contra ataques adversários, modificações não autorizadas e ciberameaças emergentes

A responsabilização garante que os sistemas de IA têm uma supervisão designada, impedindo a tomada de decisões não regulamentadas e reforçando o controlo humano

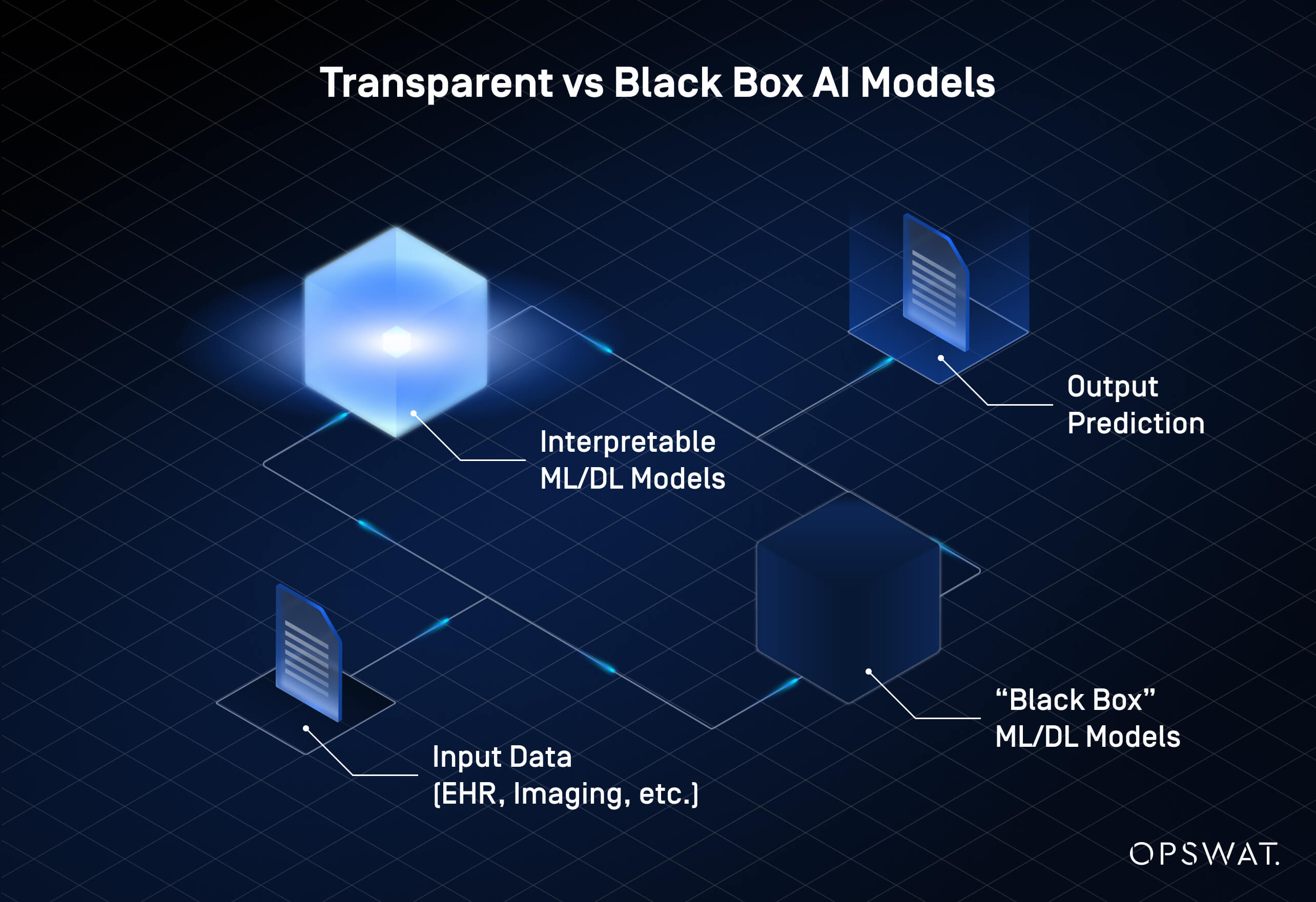

A transparência exige que os modelos de IA forneçam informações claras sobre os seus processos de tomada de decisão, reduzindo os riscos de modelos de caixa negra que não são interpretáveis

Ao incorporar estes princípios nos quadros de governação, as organizações podem mitigar os riscos, mantendo a eficiência e a escalabilidade das tecnologias de IA.

A crescente necessidade de gestão dos riscos da IA

A rápida adoção da IA introduziu novos desafios na gestão do risco e na conformidade. Sem estratégias adaptativas, as organizações correm o risco de ficar para trás na resposta às ameaças emergentes e às pressões regulamentares.

A gestão dos riscos da IA centra-se nos seguintes aspectos

- Alinhar as estratégias de governação com os regulamentos em evolução e os mandatos de supervisão de IA específicos do sector garante que as organizações cumprem os requisitos legais

- A deteção contínua de preconceitos e as auditorias de equidade são necessárias para evitar padrões discriminatórios na tomada de decisões da IA

- Os ataques de phishing com recurso a IA, a fraude deepfake e a manipulação de modelos são preocupações crescentes, exigindo medidas de segurança proactivas

Para se manterem à frente destes riscos, as organizações devem incorporar a governação da IA em estruturas mais amplas de gestão de riscos, garantindo que as considerações de conformidade, segurança e ética permaneçam integradas no desenvolvimento e implementação da IA.

Quadros de governação da IA

Uma estrutura de governação de IA estruturada ajuda as organizações a navegar pelos requisitos de conformidade, a gerir riscos e a integrar medidas de segurança nos sistemas de IA. A incorporação de um modelo claro de governação da segurança nos quadros de gestão do risco da IA reduz a fragmentação das iniciativas de IA e reforça a cobertura da conformidade.

Desenvolvimento do quadro

O desenvolvimento de um quadro de governação da IA requer uma abordagem estratégica que se alinhe com as políticas organizacionais e as normas regulamentares. Os seguintes elementos representam componentes essenciais de um processo de desenvolvimento de estrutura eficaz:

Avaliação dos riscos

Identificar vulnerabilidades nos modelos de IA, incluindo preconceitos, preocupações com a privacidade e ameaças à segurança.

Integração regulamentar

Assegurar que a governação da IA está em conformidade com os requisitos específicos do sector e com as normas globais.

Colaboração interfuncional

Criar um quadro de governação que aborde tanto as preocupações éticas como as necessidades operacionais.

Integração com as políticas organizacionais existentes

A governação da IA não deve funcionar de forma isolada, mas sim alinhada com políticas empresariais mais amplas sobre cibersegurança, ética e gestão de riscos. A incorporação de políticas de IA na gestão do risco empresarial garante que os modelos de IA cumprem os protocolos de segurança e as diretrizes éticas.

Os mecanismos de auditoria de IA podem ajudar a detetar precocemente falhas de governação, enquanto o acompanhamento da conformidade permite que as organizações se mantenham à frente dos regulamentos em evolução. As parcerias externas com fornecedores de IA e fornecedores de segurança também podem melhorar as estratégias de governação, reduzindo os riscos associados a soluções de IA de terceiros.

Estratégias de implementação

A governança de IA bem-sucedida requer uma abordagem de implementação estruturada, aproveitando tanto a tecnologia quanto as estratégias orientadas por políticas. Muitas organizações estão a recorrer a ferramentas de conformidade baseadas em IA para automatizar os processos de governação e detetar violações regulamentares em tempo real. As principais medidas de implementação incluem:

- As soluções de conformidade orientadas para a tecnologia utilizam a IA para acompanhar a adesão às políticas, monitorizar os factores de risco e automatizar os procedimentos de auditoria

- As estratégias de gestão da mudança asseguram que as políticas de governação da IA são adoptadas em toda a organização

- O planeamento da resposta a incidentes aborda os riscos de segurança específicos da IA, garantindo que as organizações dispõem de medidas proactivas para gerir falhas de governação, ciberataques e violações éticas

Ao incorporar estruturas de governação nas políticas existentes e ao adotar estratégias de implementação estruturadas, as organizações podem garantir que os sistemas de IA permanecem seguros, éticos e em conformidade.

Diretrizes éticas e responsabilidade

Como os sistemas de IA influenciam decisões de alto risco, as organizações devem estabelecer diretrizes éticas e estruturas de responsabilização para garantir uma utilização responsável. Sem salvaguardas de governação, a IA pode introduzir preconceitos, comprometer a segurança ou operar fora dos limites regulamentares.

Estabelecimento de diretrizes éticas

A governação ética da IA centra-se na equidade, transparência e segurança. As seguintes práticas são essenciais para construir uma base ética no desenvolvimento e implantação da IA:

- Os princípios e normas para uma IA ética ajudam a garantir que a IA funciona dentro de limites aceitáveis, evitando consequências indesejadas

- O desenvolvimento de um código de ética formaliza a utilização responsável da IA, estabelecendo diretrizes claras sobre transparência, privacidade dos dados e responsabilidade

Criar estruturas de responsabilização

Para garantir que a governação da IA é aplicável, as organizações precisam de mecanismos que acompanhem a conformidade e permitam acções corretivas. As medidas comuns de responsabilidade incluem:

- As auditorias de IA avaliam o desempenho do modelo, a conformidade e as vulnerabilidades de segurança

- O planeamento da resposta a incidentes prepara as organizações para lidar com falhas relacionadas com a IA, violações de segurança e lapsos de governação

Ao incorporar diretrizes éticas e medidas de responsabilização nos quadros de governação, as organizações podem gerir os riscos da IA mantendo a confiança e a conformidade.

Quadros regulamentares

A conformidade com as estruturas regulamentares é fundamental, mas muitas organizações lutam para acompanhar a evolução das políticas. De acordo com a Deloitte, a incerteza regulamentar é uma das principais barreiras à adoção da IA, com muitas empresas a implementarem estruturas de governação para lidar com os riscos de conformidade.

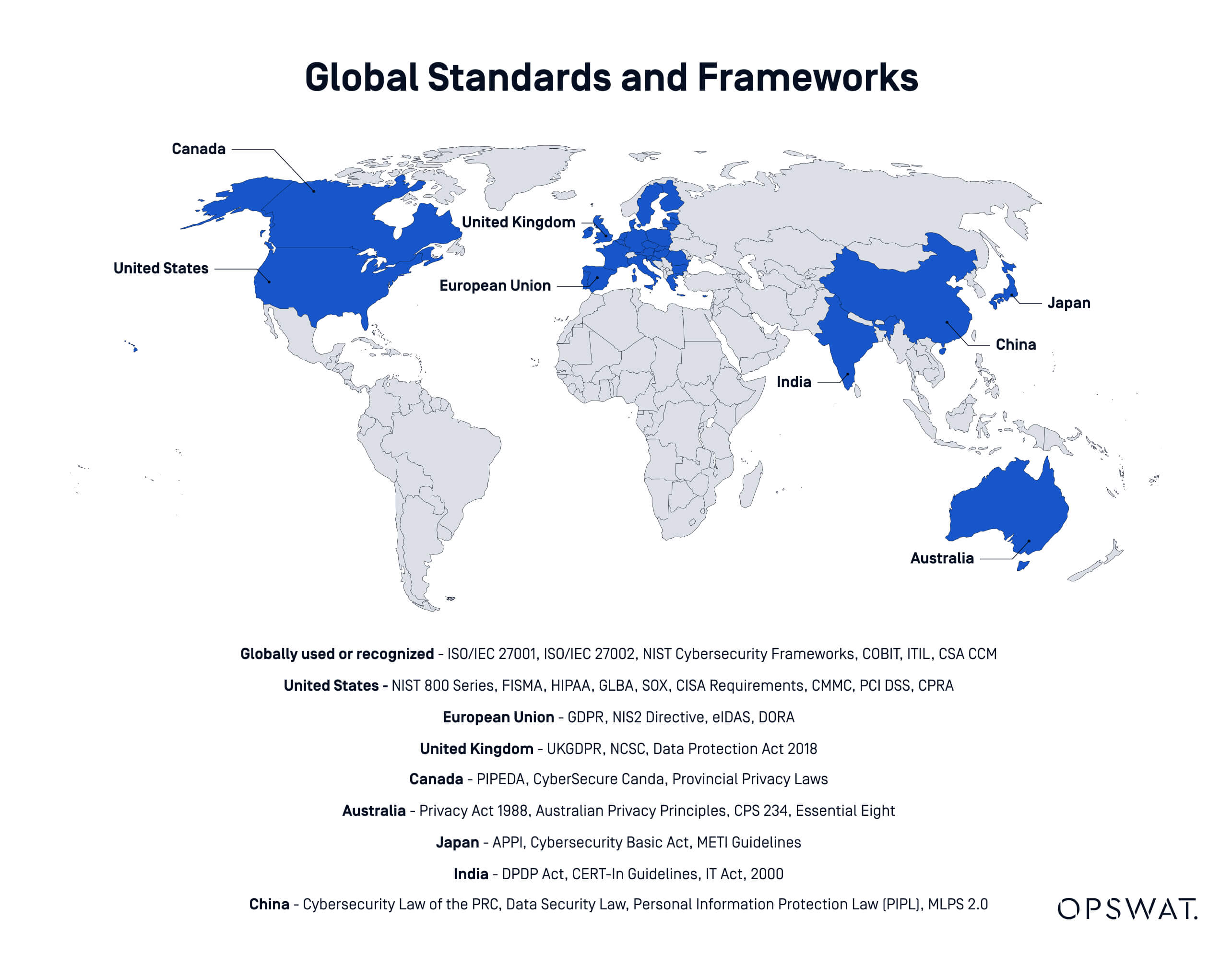

Visão geral dos regulamentos globais

A governação da IA é moldada por leis específicas de cada região, cada uma com requisitos de conformidade distintos. Os exemplos abaixo ilustram como os regulamentos variam entre as principais jurisdições:

- A Lei da IA da UE estabelece uma supervisão rigorosa, exigindo transparência, avaliações de risco e supervisão humana para aplicações de IA de alto risco. De acordo com o artigo 6.º, os sistemas de IA são considerados de alto risco se operarem em sectores de infra-estruturas críticas. As organizações que operam na UE devem alinhar as suas políticas de IA com estas diretrizes.

- O SR-11-7 dos Estados Unidos define as expectativas de gestão do risco para a IA nas instituições financeiras, centrando-se na validação do modelo, na governação e nos controlos de segurança. Estão a surgir orientações semelhantes específicas para cada sector em todas as indústrias.

- Outras políticas internacionais, incluindo regulamentos no Canadá, Singapura e China, enfatizam o uso ético da IA, a proteção do consumidor e a responsabilidade corporativa. As empresas devem acompanhar os desenvolvimentos regulamentares nas regiões onde implementam a IA.

Ao incorporar diretrizes éticas e medidas de responsabilização nos quadros de governação, as organizações podem gerir os riscos da IA mantendo a confiança e a conformidade.

Estratégias de conformidade

Garantir a conformidade com os regulamentos de IA requer uma abordagem proativa. As estratégias a seguir ajudam as organizações a alinhar as estruturas de governança com os requisitos legais em evolução, especialmente ao trabalhar com sistemas de IA de alto risco:

- A criação de uma equipa de conformidade permite às organizações gerir os riscos regulamentares, supervisionar as auditorias de IA e implementar as medidas de governação necessárias

- Enfrentar os desafios regulamentares implica um acompanhamento contínuo das alterações políticas e a adaptação das estruturas de governação num ambiente complexo de regulamentações que frequentemente se sobrepõem

- As auditorias e relatórios regulamentares ajudam as organizações a demonstrar a conformidade e a evitar riscos legais através de uma monitorização proactiva

Ao incorporar estratégias de conformidade em estruturas de governança de IA, as organizações podem mitigar os riscos regulatórios e, ao mesmo tempo, garantir que a IA permaneça ética e segura.

Transparência e explicabilidade

As organizações enfrentam uma pressão crescente para tornar as decisões baseadas em IA explicáveis, especialmente em aplicações de alto risco, como finanças, saúde e cibersegurança. Apesar disso, muitos modelos de IA permanecem complexos, limitando a visibilidade do seu funcionamento.

Conceber sistemas de IA transparentes

A transparência da IA implica tornar os processos de tomada de decisão compreensíveis para as partes interessadas, os reguladores e os utilizadores finais. As seguintes abordagens apoiam a explicabilidade da IA e ajudam a mitigar os riscos associados aos chamados modelos de IA de caixa negra, cujo funcionamento interno não é facilmente compreensível:

- Estratégias de comunicação eficazes ajudam as organizações a traduzir a tomada de decisões sobre IA em resultados claros e interpretáveis. O fornecimento de documentação, resumos de modelos e avaliações de impacto pode melhorar a transparência.

- As ferramentas e tecnologias de transparência garantem uma IA explicável, oferecendo informações sobre a forma como os modelos de IA processam os dados e geram resultados. As ferramentas de auditoria de IA, os quadros de interpretabilidade e as técnicas de IA explicável (XAI) ajudam a mitigar as preocupações em torno da tomada de decisões em caixa negra.

Ao dar prioridade à transparência, as organizações podem melhorar o alinhamento regulamentar, reduzir os riscos relacionados com o enviesamento e criar confiança nas aplicações de IA.

Monitorização e melhoria contínua

A governança de IA é um processo contínuo que requer monitoramento, avaliação de risco e refinamento contínuos para garantir a segurança e a conformidade. Como os sistemas orientados por IA lidam com volumes crescentes de dados confidenciais, as organizações devem estabelecer fluxos de trabalho seguros para evitar acesso não autorizado e violações regulamentares.

As soluções de transferência gerida de ficheiros desempenham um papel fundamental na aplicação da política de IA, mantendo a auditabilidade e reduzindo os riscos de conformidade nas trocas de dados alimentadas por IA.

Métricas de desempenho e ciclos de feedback

O acompanhamento do desempenho do sistema de IA é essencial para garantir a fiabilidade, a segurança e a conformidade. As seguintes práticas contribuem para uma monitorização robusta e uma governação adaptativa:

- Fluxos de trabalhoSecure impedem o acesso não autorizado e garantem que as trocas de dados orientadas por IA sigam políticas de segurança rigorosas.Managed File Transfer MetaDefender Managed File Transfer MFT)™ OPSWATpermite que as organizações apliquem criptografia, controlos de acesso e monitorização automatizada de conformidade para reduzir o risco de exposição de dados.

- Os mecanismos de governaçãoAdaptive permitem que os modelos de IA aperfeiçoem a tomada de decisões com base em feedback contínuo, mantendo simultaneamente medidas rigorosas de segurança e conformidade. As soluções de segurança baseadas em IA, como as plataformas Managed File Transfer , ajudam a classificar dados sensíveis em tempo real, garantindo a adesão aos requisitos regulamentares em evolução.

Criação de quadros de risco para melhoria contínua

Os fluxos de trabalho baseados em IA devem ser continuamente avaliados quanto a vulnerabilidades, especialmente à medida que as ameaças cibernéticas evoluem. De acordo com o Fórum Económico Mundial, 72% das organizações inquiridas relataram um aumento dos riscos cibernéticos no ano passado, impulsionado pelo aumento do phishing, da engenharia social, do roubo de identidade e da fraude cibernética. As seguintes estratégias apoiam a resiliência a longo prazo:

- A aplicação de segurança orientada por IA protege as trocas de dados de IA, integrando deteção avançada de ameaças, prevenção de perda de dadose controlos de conformidade. MetaDefender Managed File Transfer MFT)™ garante que as organizações possam transferir dados sensíveis de IA com segurança, sem aumentar a exposição regulatória.

- A aplicação automatizada da conformidade simplifica a adesão regulamentar, aplicando políticas de segurança predefinidas a todas as transferências de ficheiros relacionadas com IA. Ao aproveitar as soluções de governança baseadas em IA, as organizações podem reduzir o risco de violações de dados e, ao mesmo tempo, manter a eficiência operacional.

Ao incorporar fluxos de trabalho de dados seguros nas estratégias de governança de IA, as organizações podem melhorar a segurança, manter a conformidade e garantir a integridade da tomada de decisões orientada por IA. Soluções como MetaDefender Managed File Transfer MFT) fornecem as salvaguardas necessárias para apoiar operações de IA seguras e em conformidade.

MetaDefender Managed File Transfer MFT) – Solução de segurança e conformidade com IA

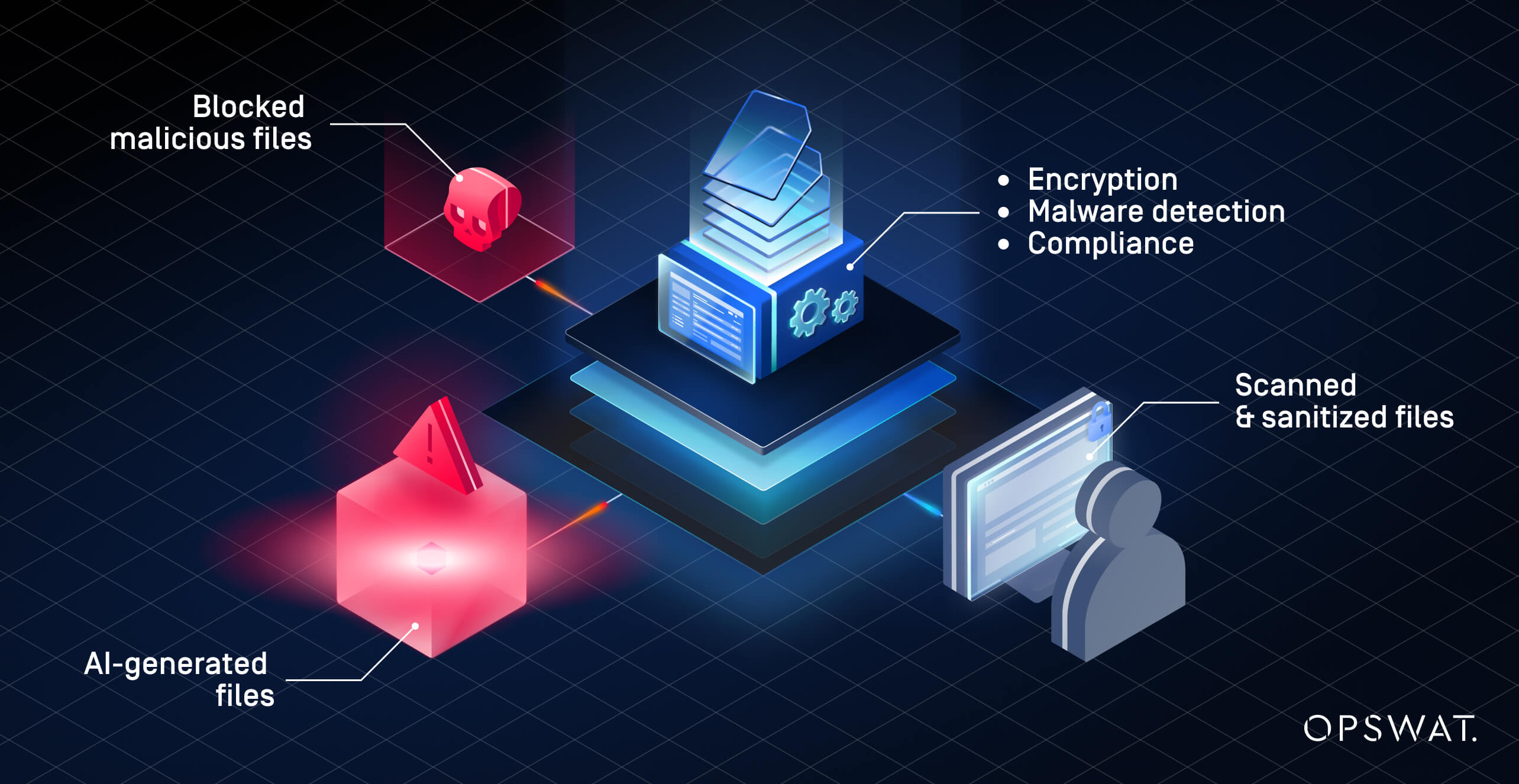

MetaDefender Managed File Transfer MFT) desempenha um papel crucial na governança de segurança de IA, fornecendo:

- Transferências de ficheiros com base em políticas que aplicam automaticamente controlos de segurança, tais como restrições de acesso, requisitos de encriptação e validação de conformidade

- Prevenção avançada de ameaças através da deteção em camadas que identifica e bloqueia malware, ransomware, scripts incorporados e outras ameaças baseadas em ficheiros habitualmente utilizadas em ataques gerados por IA

- Medidas de segurança orientadas para a conformidade que apoiam os mandatos regulamentares, incluindo o RGPD, o PCI DSS e o NIS2, integrando o registo de auditorias, os controlos de acesso baseados em funções e a aplicação de políticas personalizáveis

- Fluxos de trabalho de dadosSecure e geridos que garantem que as transferências de ficheiros orientadas para a IA são encriptadas (AES-256, TLS 1.3), verificadas em termos de integridade e protegidas contra a manipulação ou injeção de cargas maliciosas ao longo do processo de troca

- Ao integrar Multiscanning motores heurísticos e de aprendizagem automática, tecnologia Deep CDR™ e tecnologias de sandboxing alimentadas por IA, MetaDefender Managed File Transfer MFT) protege os dados gerados por IA contra ameaças cibernéticas em evolução, garantindo ao mesmo tempo a conformidade com as regulamentações de governança de IA.

Proteger os fluxos de trabalho de dados orientados para a IA

Os modelos de IA dependem de grandes volumes de dados que frequentemente se movem entre vários sistemas, tornando essenciais as transferências seguras de dados. Sem controlos adequados, os dados gerados e processados por IA podem ser vulneráveis a adulterações, acesso não autorizado ou violações de conformidade.

MetaDefender Managed File Transfer MFT) garante que os fluxos de trabalho de dados alimentados por IA permaneçam protegidos através de:

- Encriptação de ponta a ponta utilizando AES-256 e TLS 1.3, protegendo os dados em trânsito e em repouso

- Autenticação rigorosa e controlos de acesso com integração do Active Diretory, SSO (início de sessão único) e MFA (autenticação multifactor) para evitar trocas de dados não autorizadas

- Verificação da integridade dos dados através da validação da soma de verificação, garantindo que os ficheiros gerados pela IA não são adulterados durante as transferências

Ao aplicar estas medidas de segurança, as organizações podem integrar com segurança processos orientados para a IA na sua infraestrutura existente sem expor dados sensíveis a riscos.

Prevenção de ameaças com base em IA

O conteúdo gerado por IA apresenta novos desafios de segurança, incluindo ataques adversários de IA, malware incorporado e explorações baseadas em ficheiros. MetaDefender Managed File Transfer MFT) reforça a segurança através de várias camadas de proteção, impedindo que os ciberataques baseados em IA atinjam sistemas críticos.

A tecnologia Metascan™ Multiscanning utiliza mais de 30 mecanismos antimalware para detetar ameaças conhecidas e de dia zero, garantindo que os ficheiros gerados por IA estão livres de cargas maliciosas. Saiba mais sobre esta tecnologia aqui.

A tecnologia Deep CDR™ remove ameaças ocultas, eliminando o conteúdo ativo dos ficheiros e preservando a usabilidade — um passo crítico para prevenir explorações geradas por IA. Leia mais sobre como funciona aqui.

MetaDefender deteta malware evasivo executando ficheiros suspeitos trocados por IA num ambiente isolado, analisando o seu comportamento para descobrir ameaças indetetáveis por medidas de segurança tradicionais. Leia aqui o que os clientes dizem sobre esta tecnologia.

Esses recursos tornam MetaDefender Managed File Transfer MFT) uma solução de segurança abrangente para organizações que dependem de trocas de dados orientadas por IA e precisam evitar a infiltração de malware e violações de conformidade.

Governação da IA orientada para a conformidade

Os dados gerados por IA estão sujeitos a uma supervisão regulatória rigorosa, exigindo que as organizações implementem políticas de segurança que garantam a conformidade com os quadros legais em constante evolução. MetaDefender Managed File Transfer MFT) ajuda as empresas a cumprir esses requisitos, integrando controlos de conformidade proativos em todas as transferências de ficheiros:

- O Proactive DLP™ analisa os ficheiros gerados por IA em busca de conteúdo sensível, evitando a exposição não autorizada de dados e garantindo a conformidade com regulamentos como o RGPD, o PCI DSS e o NIS2

- Os registos de auditoria abrangentes e os relatórios de conformidade proporcionam visibilidade das transferências de ficheiros relacionadas com a IA, permitindo às organizações acompanhar o acesso, as modificações e a aplicação de políticas

- Os RBAC (controlos de acesso baseados em funções) aplicam permissões granulares, garantindo que apenas os utilizadores autorizados podem aceder ou transferir ficheiros relacionados com a IA, de acordo com as políticas de governação

Com esses recursos de governança, MetaDefender Managed File Transfer MFT) não apenas protege os dados de IA, mas também ajuda as organizações a se alinharem com os requisitos regulatórios, reduzindo os riscos legais e operacionais associados aos processos orientados por IA.

Reforce a segurança da IA com MetaDefender Managed File Transfer MFT)

Os fluxos de trabalho de dados orientados por IA exigem controlos robustos de segurança e conformidade. MetaDefender Managed File Transfer MFT) oferece prevenção avançada contra ameaças, conformidade regulatória e soluções seguras de troca de dados para ambientes orientados por IA. Saiba mais sobre como a solução de transferência de ficheiros gerida líder do setor OPSWAT,MFT melhorar a sua estratégia de governança de IA.